date:2025-11-28 11:40:53

更智能的成像:當AI遇見自動化細胞顯微鏡技術(shù)

近年來,自動化與人工智能的結(jié)合徹底改變了細胞成像領域。自動化技術(shù)的到來率先改變了成像的日常實踐,它通過自動化重復性工作并大規(guī)模標準化采集過程,從而重塑了細胞成像。例如,自動化載物臺能夠可靠地對數(shù)百個孔板進行聚焦;采集軟件能在不同孔板之間應用一致的曝光和照明設置;培養(yǎng)系統(tǒng)能維持穩(wěn)定的溫度和CO?濃度,使活細胞能夠自然生長。這些自動化技術(shù)的應用,帶來了更清晰、可重復的圖像,顯著減少了人工操作和變異的來源。

隨后,人工智能(AI)成為下一個重要的技術(shù)層。它通過檢測細胞和細胞器,并測量跨通道和時間序列中的強度、紋理、形狀及運動,將海量圖像數(shù)據(jù)轉(zhuǎn)化為定量的分析結(jié)果。機器學習,尤其是深度學習的最新進展,使得模型能夠識別簡單和復雜成像數(shù)據(jù)中隱藏的細微結(jié)構(gòu)[1]。深度學習模型可以直接從數(shù)據(jù)中學習表型,區(qū)分健康與應激細胞,根據(jù)化合物的效果進行分組,并識別肉眼難以察覺的表面模式。其帶來的巨大優(yōu)勢在于速度、客觀性和深度,模型能夠?qū)γ恳粠瑘D像應用相同的評判標準。

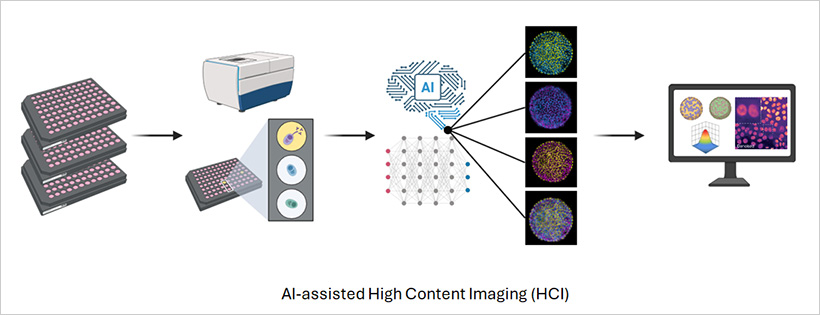

自動化和人工智能共同催生了一種新的顯微鏡技術(shù),即高內(nèi)涵成像 (High-Content Imaging)。通過結(jié)合自動化采集和智能分析,研究人員能夠超越簡單的快照式觀察,生成豐富、多維的數(shù)據(jù)集,從而描述細胞的行為、相互作用以及它們?nèi)绾雾憫車h(huán)境[2]。

何為高內(nèi)涵成像?

高內(nèi)涵成像(High-Content Imaging,HCI)將自動化和人工智能在一個單一工作流程中結(jié)合起來。自動化顯微鏡跨越多個孔板捕獲數(shù)千張圖像,而分析管道則從每個孔中的每個細胞提取詳細信息。HCI不依賴于單一的檢測指標,而是測量廣泛的參數(shù),包括形態(tài)、熒光強度、蛋白質(zhì)定位和細胞器行為。

由于工作流程是自動化的,每個孔板都在一致的條件下進行成像。先進的軟件可以維持焦點、曝光和照明,確保生成的數(shù)據(jù)集既可重復又可比較。現(xiàn)代自動化顯微鏡配備了熒光和共聚焦成像功能,結(jié)合AI分析軟件,能夠提高表型分析的通量和準確性,使大規(guī)模篩選比以往任何時候都更快、更可靠[3]。其最終結(jié)果是一個精確的表型圖譜,能夠捕捉細胞如何跨越空間和時間對藥物、刺激或基因變化做出響應。

圖1 | 高內(nèi)涵成像實驗示意圖

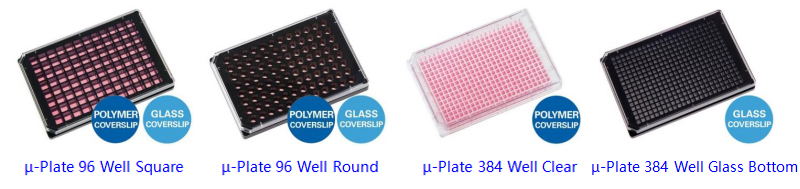

為了支持這一工作流程,成像級的實驗室耗材起著至關重要的作用。ibidi的 µ-Plate 96 Well 3D, µ-Plate 96 Well Square, µ-Plate 96 Well Round, 和µ-Plate 384 Well Glass Bottom專為高通量顯微鏡而設計。其#1.5 Polymer聚合物或#1.5H Glass玻璃蓋玻片底部為熒光和共聚焦成像提供了所需的光學清晰度,而黑色壁的設計則最大限度地減少了孔間串擾。這些特性確保了所捕獲的每張圖像在質(zhì)量上都保持一致,并為基于AI的分析做好準備。

自動化與人工智能的協(xié)同優(yōu)勢

自動化與人工智能結(jié)合的強大之處在于二者的互補性:自動化生成海量、一致性的數(shù)據(jù)集,人工智能從中提取意義。二者協(xié)同可加速科學發(fā)現(xiàn),提高實驗的可重復性,并拓展可測量內(nèi)容的邊界。

規(guī)模與速度

自動化成像系統(tǒng)可以在幾分鐘內(nèi)處理整塊多孔板,在無人干預的情況下捕獲數(shù)千張圖像。某些設置甚至能在短短兩小時內(nèi)完成四十塊96孔板的成像。這種規(guī)模使得研究人員能夠探索完整的化合物庫、進行大規(guī)模基因篩選或開展手動實驗無法完成的延時實驗。自動化使高通量成像既高效又常規(guī)化,讓研究人員能夠?qū)⒕性跀?shù)據(jù)解讀而非圖像采集上。

洞察深度

人工智能從每張圖像中提取數(shù)百個參數(shù),揭示隨時間演變的細微形態(tài)或分子變化。深度學習(尤其是卷積神經(jīng)網(wǎng)絡 (CNNs))已成為圖像分析的基石[4]。這些模型能直接從數(shù)據(jù)中學習表型特征,識別健康細胞與應激細胞的差異,根據(jù)表型特征分類化合物效應,并發(fā)現(xiàn)肉眼不可見的新細胞狀態(tài)[5]。一旦模型訓練完成,同一模型可在數(shù)分鐘內(nèi)分析新數(shù)據(jù)集,完成人類分析師需耗時數(shù)日甚至數(shù)周的工作。這使顯微鏡從描述性工具蛻變?yōu)槔斫饧毎袨榈呢S富、定量平臺。

可重復性與客觀性

自動化確保成像條件完全一致。人工智能對每幀圖像應用相同的客觀規(guī)則,從而減少偏差并提升跨培養(yǎng)板、儀器及地點的可重復性。這種一致性對大規(guī)模、多中心實驗至關重要,有助于將成像技術(shù)真正轉(zhuǎn)化為一門定量學科。

與3D模型的兼容性

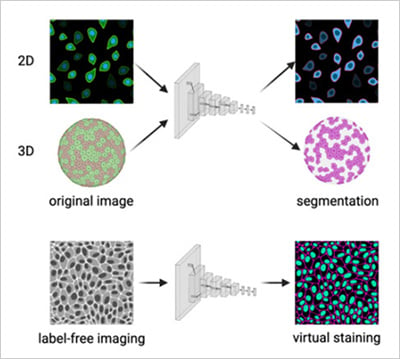

隨著生物學向更逼真的模型發(fā)展,人工智能與自動化技術(shù)使3D球體、類器官及共培養(yǎng)體系的研究精度可媲美2D系統(tǒng)[6][7]。自動化顯微鏡能穿透厚樣本保持聚焦,人工智能算法則可隨時間推移重建并量化3D結(jié)構(gòu)(圖2a)。在患者來源類器官研究中,高內(nèi)涵成像結(jié)合人工智能技術(shù)已能預測個體腫瘤對特定藥物的反應,為數(shù)據(jù)驅(qū)動的精準醫(yī)療鋪平道路[8]。

ibidi µ-Plate 96 Well 3D 96孔3D培養(yǎng)板支持均勻的球體形成和長時程穩(wěn)定成像,為復雜模型的定量高內(nèi)涵成像提供可靠平臺。

圖2 | a) 卷積神經(jīng)網(wǎng)絡對2D與3D顯微數(shù)據(jù)集進行細胞分割。b) 卷積神經(jīng)網(wǎng)絡從無標記明場圖像預測熒光通道(虛擬染色)。改編自Carreras-Puigvert, J., et al., 2024[11]。

新發(fā)現(xiàn)與預測性洞察

人工智能檢測細微模式的能力催生了新型生物學發(fā)現(xiàn)。深度學習可按作用機制對化合物進行分組,揭示脫靶效應,并識別疾病早期標志物。在活細胞成像中,人工智能現(xiàn)可實時追蹤細胞運動、分裂及形態(tài)變化,揭示細胞如何動態(tài)響應藥物或基因擾動。這使延時成像成為高內(nèi)涵篩選的核心組件,為細胞響應動力學研究提供關鍵洞察[9][10]。

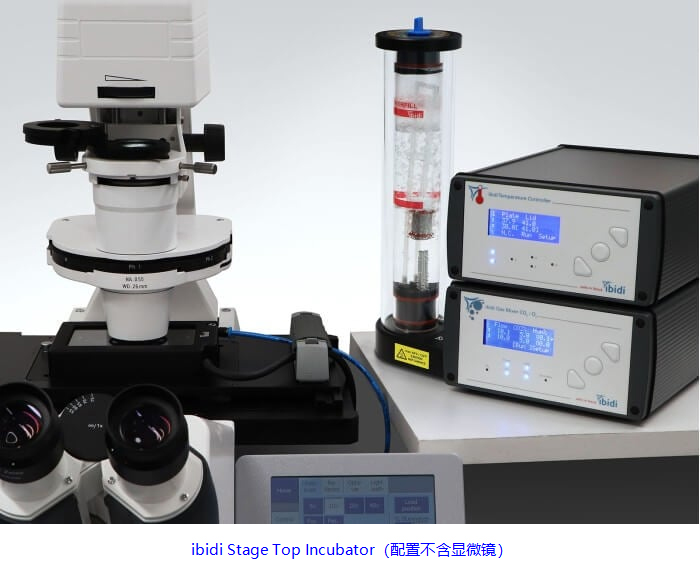

為保障長期活細胞實驗的穩(wěn)定性與可重復性,ibidi Stage Top Incubators(載物臺培養(yǎng)箱/活細胞工作站)可在顯微鏡載物臺上直接精準控制溫度、濕度、CO?及O?濃度。該技術(shù)確保細胞在長期延時研究中保持最佳健康狀態(tài)與恒定成像條件。

與此同時,新型生成式人工智能模型正被用于預測分析,能夠模擬細胞反應,或基于現(xiàn)有成像數(shù)據(jù)提出新的實驗條件(圖2b)。

智能成像的未來

人工智能、自動化與先進顯微技術(shù)的融合,正在重塑科學家從圖像中獲取知識的邊界。不久的將來,人工智能不僅能分析數(shù)據(jù),更能實時引導顯微鏡操作——自動調(diào)節(jié)焦距、識別關鍵事件,或在必要時觸發(fā)更高分辨率的成像。

貫穿樣本制備、圖像采集、分析與可視化的全流程成像管道已初現(xiàn)雛形。隨著技術(shù)持續(xù)進步,更快速、更精準、更具預測性的成像,使研究者能夠以前所未有的深度和規(guī)模來測量與解讀細胞過程。

對科學家而言,這意味著將花費更少的時間在重復性工作上,而將更多的時間用于解讀生物學數(shù)據(jù)。而對于細胞成像本身而言,這標志著它正從僅僅“觀察生命”轉(zhuǎn)向借助自動化和人工智能的聯(lián)合力量來“理解生命”。

參考文獻

[1] Wong, F., et al., Discovery of a structural class of antibiotics with explainable deep learning. Nature, 2024. 626(7997): p. 177-185.

[2] Way, G.P., et al., Evolution and impact of high content imaging. SLAS Discovery, 2023. 28(7): p. 292-305.

[3] Kupczyk, E., et al., Unleashing high content screening in hit detection – Benchmarking AI workflows including novelty detection. Computational and Structural Biotechnology Journal, 2022. 20: p. 5453-5465.

[4] Gupta, A., et al., Deep Learning in Image Cytometry: A Review. Cytometry Part A, 2019. 95(4): p. 366-380.

[5] Pachitariu, M. and C. Stringer, Cellpose 2.0: how to train your own model. Nature Methods, 2022. 19(12): p. 1634-1641.

[6] Choo, N., et al., High-Throughput Imaging Assay for Drug Screening of 3D Prostate Cancer Organoids. SLAS Discovery, 2021. 26(9): p. 1107-1124.

[7] Betge, J., et al., The drug-induced phenotypic landscape of colorectal cancer organoids. Nature Communications, 2022. 13(1): p. 3135.

[8] Jiménez-Luna, J., et al., Artificial intelligence in drug discovery: recent advances and future perspectives. Expert Opinion on Drug Discovery, 2021. 16(9): p. 949-959.

[9] Yang, X., et al., A live-cell image-based machine learning strategy for reducing variability in PSC differentiation systems. Cell Discovery, 2023. 9(1): p. 53.

[10] Wiggins, L., et al., The CellPhe toolkit for cell phenotyping using time-lapse imaging and pattern recognition. Nature Communications, 2023. 14(1): p. 1854.

[11] Carreras-Puigvert, J. and O. Spjuth, Artificial intelligence for high content imaging in drug discovery. Current Opinion in Structural Biology, 2024. 87: 102842.

ICP備案號:

滬ICP備15057650號-1

滬公網(wǎng)安備31011202005471

滬公網(wǎng)安備31011202005471

雷萌生物科技(上海)有限公司 保留所有版權(quán).